Tags: Paper URL1: https://arxiv.org/pdf/1905.11946.pdf URL2: https://arxiv.org/pdf/2104.00298.pdf

提出了一种模型缩放策略,如何更高效的平衡网络的深度、宽度、和图片分辨率 1. Efficient Net: Rethinking Model Scaling for Convolutional Neural Networks 2. EfficientNetV2: Smaller Models and Faster Training

@Aiken H 2021 find detail to code his

Efficient Net V1

除了提出了缩放策略以外,还使用神经架构搜索还建立了一个新的baseline network,得到了一系列模型。

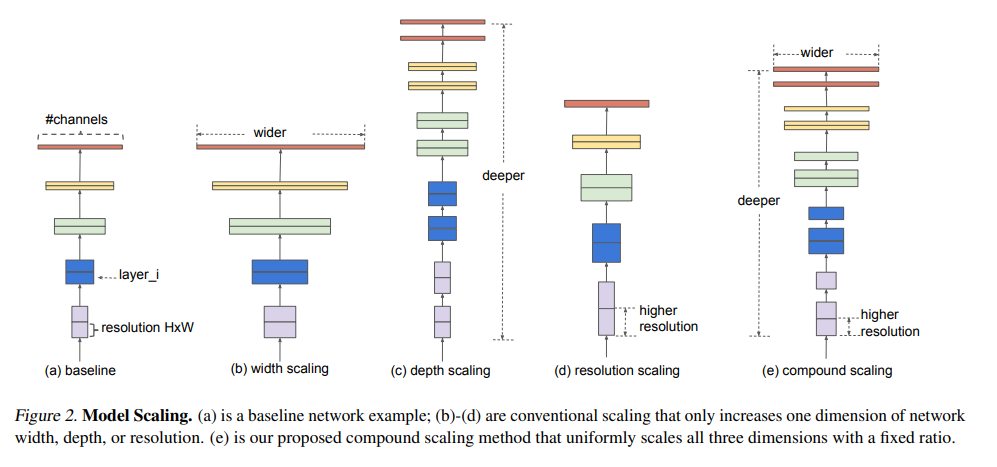

平衡网络宽度、深度、分辨率至关重要,这种平衡可以通过简单的恒定比率缩放维度来实现,于是我们提出了一种简单有效的复合缩放方法。

复合缩放的物理意义:输入图像更大的话就需要更多层来增加感受野和更多通道,从而能在更大的图像上捕获更多细粒度的图案,而宽度和深度(对于表达能力来说很重要)之间也存在着一定的关系,“我们”是第一个对此进行了建模的。

从各个维度单独的进行缩放能发现都存在着增益瓶颈,如何去得到这么一个合适的等比缩放增益

Motivation and Method

一些直观上的motivation,以及假想

- 不同的缩放维度不是独立的

- 直观上,对于更高分辨率的图像我们应该增加网络深度。 这样更大的感受野可以帮助捕捉更大图像中包含的更多像素的相似特征

- 相应的,更高分辨率的图像也应该增加网路的深度以便再高分辨率图像中捕获具有更多像素的更细粒度的图案。

基于实验最终得到了这样的结果:

求解方法:

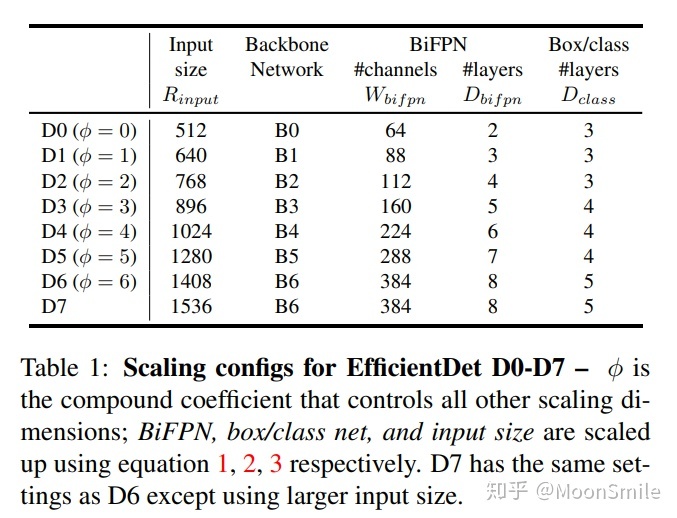

- 固定φ,然后通过网格搜索得到最基本的模型 Efficient Net-B0

- 固定α、β、γ的值,使用不同的φ,得到相应的B1 -B7

Experience Detail

EfficientNet网络结构图_LYS_1129的博客-CSDN博客_efficientnet网络结构

EfficientNet网络解析_bblingbbling的博客-CSDN博客_efficientnet网络结构

EfficientNet B0-B7 网络参数_繁华落尽,寻一世真情的博客-CSDN博客

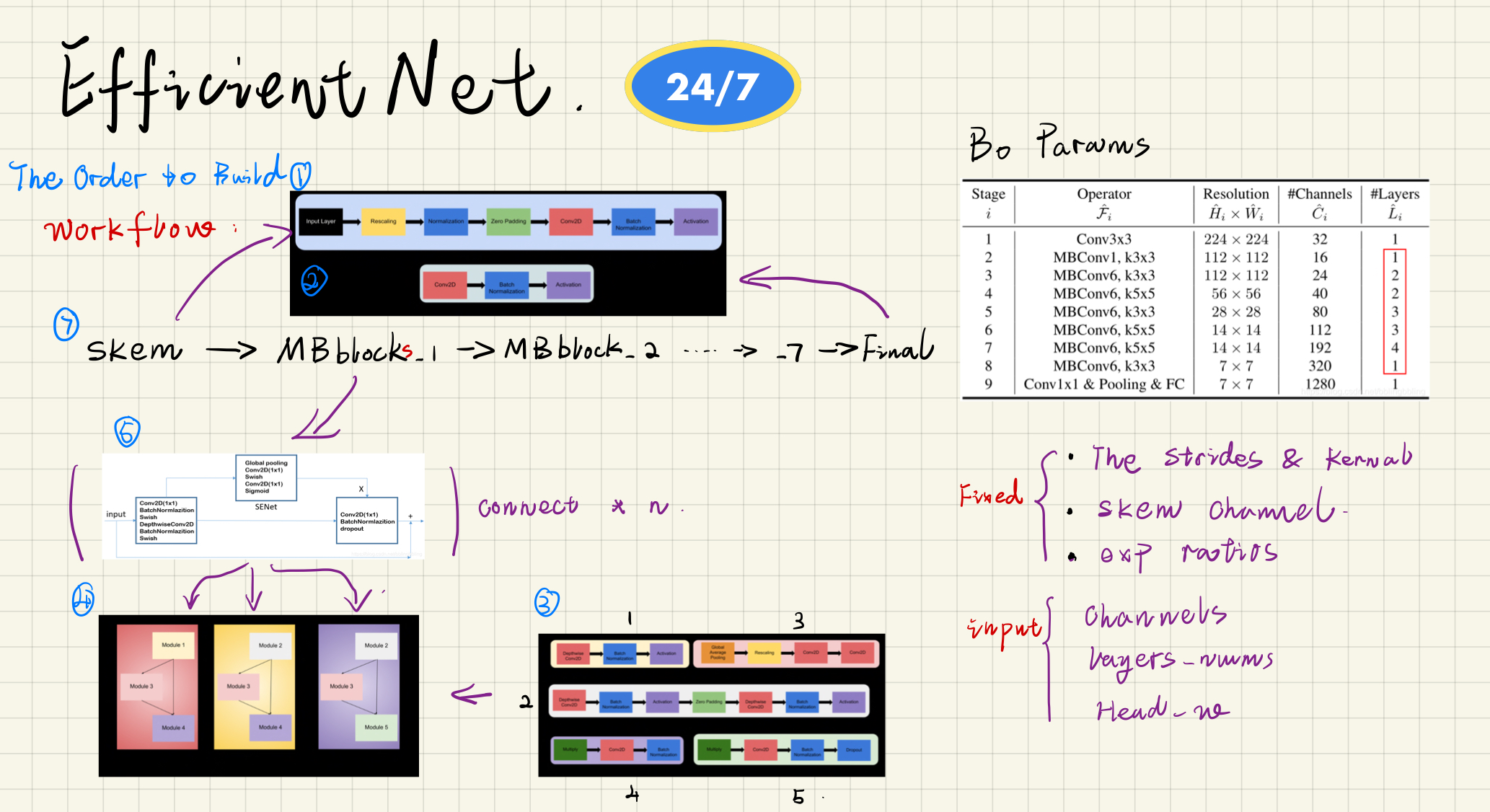

从第三个连接中,我们可以整理出那些需要input的相关参数,然后输入网络中去建立该Model。

实现中的问题:

blockN

- stride和padding在各个重复组合层中间的变化(只有DW卷积改变Imageview)(堆叠的层不改变相应的HW),也是由第一个层去进行处理

- channel,在各个组合层之间的变化(堆叠的层刚好不改变channel数目)